iOS 系统以其出色的稳定性和用户体验,在移动设备领域占据着重要地位,当涉及到音频录制的实时处理时,它为用户提供了一系列强大的功能和工具。

音频录制的实时处理并非一项简单的任务,它需要综合考虑多个因素,包括设备性能、音频质量要求以及应用场景等,在 iOS 中,开发者可以利用苹果提供的丰富的 API 来实现各种复杂的音频处理需求。

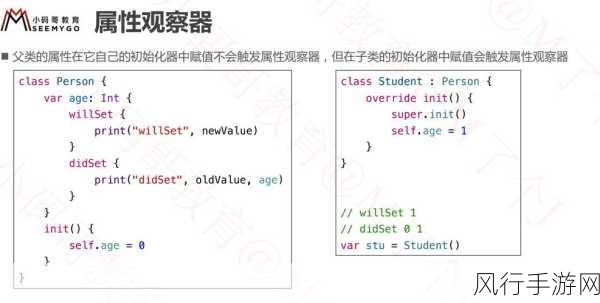

要实现 iOS 音频录制的实时处理,关键在于理解和运用相关的音频框架,AVFoundation 框架为音频的采集、录制和处理提供了强大的支持,通过这个框架,可以设置音频的采样率、声道数、编码格式等参数,以满足不同的应用需求。

还需要关注音频处理的算法和技术,噪声消除是常见的实时处理需求之一,通过分析音频信号的特征,采用合适的滤波算法,可以有效地降低环境噪声对录制音频的影响,提升音频的清晰度和可听性。

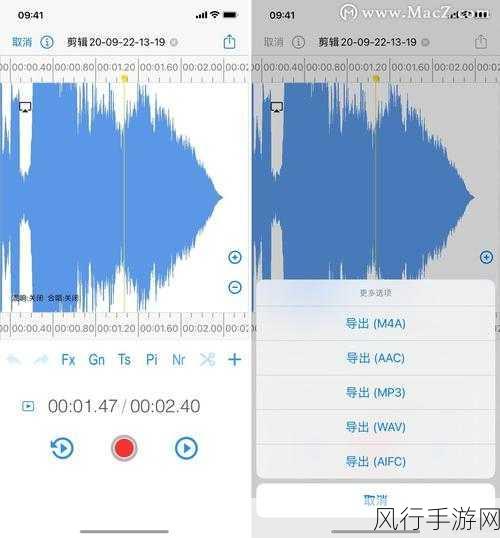

实时音频特效的添加也是一个重要方面,回声效果、变声效果等,可以为音频录制增添趣味性和创意性,这需要对音频信号进行实时的数字信号处理,以实现各种特效的实时渲染。

在实际开发中,还需要注意内存管理和性能优化,音频处理通常会涉及大量的数据计算和存储,如果处理不当,可能会导致内存泄漏、卡顿甚至应用崩溃,合理地分配和释放内存资源,采用高效的算法和数据结构,是确保音频录制实时处理流畅运行的关键。

iOS 音频录制的实时处理是一个充满挑战但又极具潜力的领域,通过深入了解相关技术和框架,结合创新的思维和实践,开发者能够为用户带来更加出色的音频录制体验,无论是用于专业的音频创作,还是日常的娱乐分享,iOS 音频录制的实时处理都有着广阔的应用前景和发展空间。